Vorbei die Jahre, als die Medienaufsicht vor allem mit Radio und Fernsehen beschäftigt war. Jetzt ist die Aufsicht auch fürs Internet zuständig – und mit dem Internet für eine schier nie enden wollende Flut an Rechtsverstößen.

Ob Extremismus, Volksverhetzung, Hakenkreuze, Pornografie oder Verherrlichung von Drogen – all das und mehr soll ein neues KI-Tool namens KIVI jetzt für die Medienaufsicht im Netz entdecken können. „Modernste“ Technologie, heißt es auf der Website der Landesmedienanstalt NRW.

Entwickelt wurde das Tool von der Berliner IT-Firma Condat. Die Herkunft des Namens erklärt Tobias Schmid, Direktor der Landesmedienanstalt Nordrhein-Westfalen, so: KIVI setze sich zusammen aus „KI“, der Abkürzung für Künstliche Intelligenz, und dem lateinischen Wort „vigilare“ – überwachen. Eine „Überwachungs-KI“ also. Schmid nennt das eine „fantastische Kombination“.

Nachdem die Medienanstalt NRW den Anfang gemacht hat, wird KIVI nun von allen 14 Landesmedienanstalten in Deutschland eingesetzt, wie die Medienaufsicht in einer Pressekonferenz am 7. April mitteilte. Von KIVI erfasst würden demnach Texte, Bilder und einzelne Frames von Videos. Unterwegs sei KIVI auf klassischen Websites sowie auf Telegram, Twitter, YouTube, TikTok, dem russischen Facebook-Konkurrenten VKontakte und dem Videoportal Bitchute.

Bereits doppelt so viele Strafanzeigen durch KI

20.000 potentielle Verstöße habe KIVI innerhalb eines Jahres erkannt. Die Verstöße werden dann in einem Ticketsystem von Menschen überprüft. Das sind laut Medienaufsicht NRW um die acht studentische Hilfskräfte und sieben Jurist:innen. Nach dem Aussortieren irrtümlicher Treffer seien 6.700 Verstöße übrig geblieben. Einige Treffer von KIVI führen etwa zu Meldungen bei den Plattformen, andere auch zu Strafanzeigen.

Die Anzahl der Strafanzeigen habe sich durch die KI verdoppelt, sagt Juristin Dr. Laura Braam. „Momentan reichen wir 30 Strafanzeigen pro Monat ein“. Vor der KI habe man das Netz händisch durchsucht. Das sei extrem zeitaufwendig gewesen. Nun erfasst die Medienaufsicht wesentlich mehr und hat entsprechend öfter mit der Polizei zu tun.

Medienaufseher Schmid bezeichnet die Zusammenarbeit mit dem Landeskriminalamt NRW als „sehr gut“. Als nächstes bereite man die Zusammenarbeit mit dem BKA vor, so Schmid. Wenn die Kolleg:innen des BKAs bei der Ermittlung helfen, „bin ich ziemlich sicher, dass wir die massenhaft auflaufenden Fälle auch sukzessive in den Griff kriegen“.

Medienaufsicht: Rechtsdurchsetzung ‚“paneuropäisch hinkriegen“

KI und Computer sind sehr gut darin, Dinge zu skalieren – und genau das liegt offenbar im Interesse der Medienaufsicht. Mehr Überwachung, mehr entdeckte Rechtsverstöße, mehr Anzeigen. Der Einsatz von KIVI durch alle deutschen Landesmedienanstalten ist nur der Anfang. Medienaufseher Schmid hofft auf ganz Europa. „Es gibt keine andere Nation, die ein vergleichbares Instrumentarium hat zur Rechtsdurchsetzung im Netz“, sagt Schmid. Zu den nächsten Fragen gehöre: „Wie sorgen wir dafür, dass wir das paneuropäisch hinkriegen?“

Der Grundstein dafür ist gelegt. Regulierungsbehörden der 27 EU-Mitgliedstaaten haben sich im Jahr 2014 in einer Gruppe namens ERGA (European Regulators Group for Audiovisual Media Services) zusammengeschlossen, 2020 und 2021 war Schmid Vorsitzender des Gremiums. Mit Vorstößen wie dem KIVI scheint sich Deutschland in der Gruppe hervorzutun. Darüber hinaus spricht Schmid eine mögliche, zusätzliche Unterstützung vonseiten der Plattformen an. „Ich glaube schon, dass die Plattformen dazu verpflichtet werden sollten, uns dabei zu helfen“.

KIVI könnte zudem noch deutlich mehr Verdachtsfälle liefern als aktuell. Derzeit schicke man KIVI nur wochentags drei bis vier Stunden lang auf die Suche, erklärt Sacha Prelle von der IT-Firma Condat. Man könne KIVI aber auch 24/7 laufen lassen. Das Problem sei die Menge der Treffer.

Mit Menge kennen sich große Plattformen wie Facebook und TikTok gut aus. Sie beschäftigen Tausende Löscharbeiter:innen, die missbräuchliche Inhalte überprüfen und löschen. Dabei kommen auch KI-Tools zum Einsatz. Seit Jahren zeigen journalistische Recherchen: Selbst bei konzentrierter Arbeit im Akkord können Plattformen die Löscharbeit ihrer eigenen Inhalte allenfalls mühsam bewältigen. Immer wieder klagen Angestellte über belastende Arbeitsbedingungen und traumatische Folgen der Arbeit.

Es nicht zu tun, sei „keine Option“

Während die reichsten Konzerne der Welt also das Problem der Löscharbeit kaum stemmen können, möchte nun auch die deutsche Medienaufsicht selbst Löscharbeit machen – Inhalte aufspüren, finanziert durch den Rundfunkbeitrag. Warum?

„Mein Job ist in einem Punkt ganz einfach“, erklärt Schmid in der Pressekonferenz. „Wir sind eine Exekutivbehörde mit einem gesetzlichen Auftrag.“ Der Auftrag laute: „Ich soll die Rechtsordnung, so wie sie besteht, verteidigen, um Freiheit zu ermöglichen“. Es könne sein, dass man im Moment nur einen winzigen Teil der Delikte mitbekomme, so Schmid. Aber die Alternative wäre, es zu lassen. Das sei keine Option.

Als Beispiel beschreibt Schmid ein Szenario, wie es wäre, wenn man Plattformen wie Facebook die Verantwortung allein überlassen würde. Das führe dazu, dass man damit leben müsse, „dass in Zukunft der moralische, politische, emotionale Maßstab von Herrn Zuckerberg“ entscheide. Es gebe zwar das NetzDG (Netzwerkdurchsetzungsgesetz), aber das sei ein „sehr eingeschränkter Bereich von Delikten“. Das NetzDG erfasst etwa volksverhetzende Inhalte oder öffentliche Aufrufe zu Straftaten.

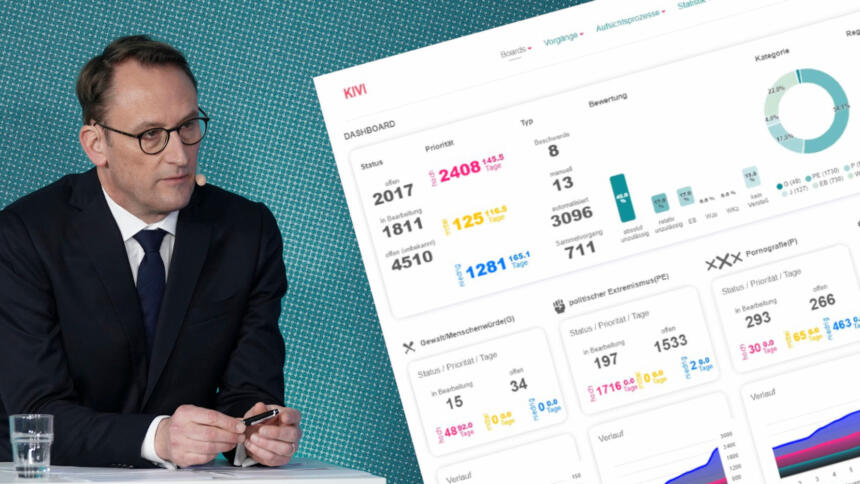

Einen kurzen Einblick in die konkrete Arbeit der KI gab es zu Beginn der Pressekonferenz. Eine Mitarbeiterin teilte ihren Bildschirm und zeigte die Oberfläche von KIVI. Ein Counter zeigte die Zahl 23.341. Sichtbar waren die jüngsten 20 Ergebnisse. Sie alle wurden laut Zeitstempel am Morgen des 7. April gefunden. Gleich neun dieser Ergebnisse kamen von zentralrat.de – das ist die Website des Zentralrats der Muslime. Anfang dieses Jahres hat der Zentralrat der Muslime laut Deutscher Presse-Agentur einen Verein ausgeschlossen, den der Verfassungsschutz dem Netzwerk der Muslimbrüder zurechnet.

Extremismus-Treffer beim Zentralrat der Muslime

Neben den neun Treffern von zentralrat.de war das Symbol einer gereckten Faust zu sehen. Bei KIVI steht das für „politischen Extremismus“, beispielsweise Volksverhetzung. Die dazu gehörigen URLs waren sichtbar. Tippt man eine davon in den Browser, erscheint eine Pressemitteilung vom 7. Juli 2005, in der es hießt: „Der Zentralrat der Muslime in Deutschland (ZMD) ist erschüttert und entsetzt über die Serie der barbarischen Terroranschläge in London.“ Politischer Extremismus ist auf dieser Seite nicht unmittelbar zu erkennen – wohl aber Stichworte wie „Terror“ und „Islam“.

Für die kuriosen Treffer könnte es alle möglichen Gründe geben. Wir haben die Pressestelle der Landesmedienanstalt gefragt, ob hinter diesen KIVI-Treffern möglicherweise antimuslimischer Rassismus stecken könnte. Wenn wir eine Antwort erhalten, werden wir den Artikel aktualisieren.

Generell übernimmt Künstliche Intelligenz häufig Voreingenommenheiten, Vourteile und Verzerrungen ihrer Trainingsdaten. Dieses Phänomen wird als Bias bezeichnet. Die KI der Medienaufsicht sei unter anderem mit Material der Landesmedienanstalt NRW trainiert worden, erklärt Sacha Prelle von der IT-Firma Condat. Sie lerne kontinuierlich dazu, wenn bei der Überprüfung durch Menschen Treffer als irrtümlich gekennzeichnet werden. Medienaufseher Schmid bezeichnet das KI-Tool in der Pressekonferenz als „neutral“, die Suche als „so herrlich unkorrupt“.

Ein klarer Vorteil von KIVI ist, dass Mitarbeiter:innen der Medienaufsicht nicht mehr unmittelbar mit möglicherweise traumatischen Inhalten konfrontiert werden. KIVI präsentiert Bilder zunächst in einem kleinen Vorschaufenster und stark verschwommen. Mitarbeiter:innen können zunächst lesen, um welche Art von Inhalt es sich möglicherweise handelt – etwa Gewalt oder Pornografie. Dann können sie mit einem Schieberegler vorsichtig die Bildschärfe erhöhen, um den Inhalt zu überprüfen. Solche Maßnahmen wurden etwa auch für TikTok-Löscharbeiter:innen gefordert, damit die Löscharbeit weniger belastend ist.

Hilf mit! Mit Deiner finanziellen Hilfe unterstützt Du unabhängigen Journalismus.

0 Commentaires