Eine Woche vor den Zwischenwahlen in den USA pausiert Meta politische Werbung. Der Konzern sieht sich gerüstet für den Umgang mit Falschinformationen im Umfeld von Wahlen – aber NGOs sehen das anders.

Facebook-Mutter Meta bereitet sich auf kommende Wahlen vor. Auf der eigenen Website erklärt der Konzern, man richte für die Woche vor den Zwischenwahlen in den USA am 8. November eine Blackout-Periode für politische Werbung ein. Das bedeutet, Werbetreibende können während dieser Zeit auf Facebook keine Werbung zu sozialen Themen, Wirtschaft oder Politik in den USA schalten. Lediglich bereits veröffentlichte Werbungen werden angezeigt.

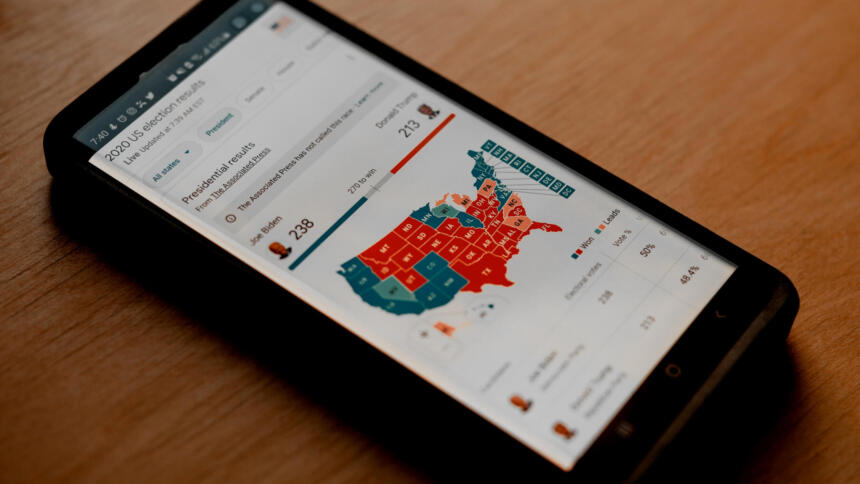

Diese Strategie hat der Konzern schon einmal gewählt, bei den US-Wahlen in 2020. Damals wie heute begründet Meta diesen Schritt damit, dass unmittelbar vor einer Wahl nicht genug Zeit sei, sich mit den in Werbung enthaltenen Aussagen angemessen auseinanderzusetzen. So beschreibt es Nick Clegg, der bei Meta für globale Angelegenheiten zuständig ist. Das bedeutet, in der aufgeheizten Zeit vor der Wahl sei es schwieriger, Werbung oder Posts mit falschen Angaben herauszufiltern, etwa einen falschen Wahltermin oder falsche Angaben dazu, wer wählen darf.

USA: Lehren aus dem Sturm aufs Kapitol

Auch Werbung mit falschen Angaben zum Wahlergebnis will Meta verbieten. Einen Einfluss auf diese Entscheidung dürfte auch der 6. Januar 2021 gehabt haben, als Anhänger:innen von Donald Trump das US-Kapitol stürmten. Am Tag der Amtsübergabe an den Demokraten Joe Biden hatten sich mehrere bewaffnete Trump-Anhänger:innen Zutritt zum Regierungsgebäude verschafft. In den sozialen Netzwerken hatte sich zuvor die Nachricht verbreitet, die Demokrat:innen hätten die Wahl manipuliert. Fünf Menschen starben.

Meta erklärt in seinem Transparenz-Zentrum, dass „Fehlinformationen entfernt werden, wenn sie wahrscheinlich direkt zur Gefahr von Gewalt bzw. Körperverletzung beitragen“. Das Unternehmen setze mehrere Gruppen von Faktenchecker:innen ein, um Aussagen zu prüfen. Werbetreibende, die wiederholt „als falsch eingestufte Informationen verbreiten“, müssten unter Umständen mit Einschränkungen rechnen.

Kenia: Facebook ließ problematische Anzeigen zu

Die Rolle von Facebook im Umfeld von Wahlen ist nicht nur in den USA ein Thema. Auch in Kenia wurde eine Auszeit für politische Werbung gefordert, und zwar von den Menschenrechtsorganistaionen Global Witness und Foxglobe sowie der Facebook-Whistleblowerin Frances Haugen. Facebook sei demnach nicht in der Lage, Falschinformationen und Hassrede ausfindig zu machen. In Kenia gab es Anfang August Präsidentschaftswahlen.

In einem Experiment hatten die Organisationen gezeigt, wie Facebook trotz Kontrollmechanismen problematische Online-Werbung zuließ. Die NGOs hatten das selbst getestet und posteten 20 bezahlte Werbeanzeigen mit Hassrede, wie etwa dem Aufruf zu Gewalttaten an ethnischen Minderheiten. Nach Facebooks Gemeinschaftsrichtlinien ist das verboten. Trotzdem habe die Plattform alle Test-Anzeigen freigeschaltet.

Brasilien: „Schutz der Demokratie nicht bloß eine Option“

Auch für die bevorstehende Wahlen in Brasilien stellt Global Witness dem Konzern kein gutes Zeugnis aus. In einem Blogpost erklärt Meta, wie es sich auf die Wahlen vorbereitet. Der Konzern arbeite mit brasilianischen Behörden zusammenzuarbeiten. Die Anzeigen würden für sieben Jahre in der Werbebibliothek gespeichert, erfasst würden auch Informationen über die Werbetreibenden.

Zum Einsatz komme auch eine KI, die Meta zufolge erfolgreich Fake-Accounts aufspüre. Sie könne bis zu 99,7 Prozent der Accounts löschen. Menschliche Moderator:innen müsste nur einen kleinen Teil an potentiellen Fake-Accounts begutachten.

Global Witness hat auch in Brasilien Werbeanzeigen zum Wahlkampf mit Falschinformationen versehen. Facebook habe alle zehn durchgewunken. In ihrem Bericht hält die NGO fest, Facebooks Bemühungen gegen Falschinformationen seien ineffektiv. Meta müsse anerkennen, dass der Schutz der Demokratie nicht bloß eine Option sei, sondern vielmehr notwendiger Teil jeder Geschäftstätigkeit, heißt es weiter.

Myanmar: Facebooks Rolle beim Völkermord an den Rohingya

Facebooks Umgang mit Falschinformationen auf der eigenen Plattform hat eine lange Vorgeschichte. Ein wichtiges Ereignis war etwa der Völkermord an den Rohingya in Myanmar. Der Fall erhielt im Jahr 2018 Aufmerksamkeit vom Human Rights Council der Vereinten Nationen. In einem über 400 Seiten starken Dokument hat eine Kommission unabhängiger Faktenchecker:innen ausgeführt, welche Rolle Facebook dabei gespielt hat.

Demnach habe Facebook Aufrufe zu Gewalt an den Rohingya nicht nur zugelassen – das Unternehmen habe auch zu wenig Moderator:innen mit den notwendigen Sprachkenntnissen beschäftigt, wodurch sich Hassrede und Falschinformationen ungehindert verbreiten konnten. Das Kriegsverbrechen an der muslimischen Minderheit hatte laut UN-Bericht 10.000 Tote zur Folge.

Die Arbeit von netzpolitik.org finanziert sich zu fast 100% aus den Spenden unserer Leser:innen.

Werde Teil dieser einzigartigen Community und unterstütze auch Du unseren gemeinwohlorientierten, werbe- und trackingfreien Journalismus jetzt mit einer Spende.

0 Commentaires